案例——使用Java API操作HDFS

本节将通过Java API来演示如何操作HDFS文件系统,包括文件上传与下载以及目录操作等,具体介绍如下:

1.搭建项目环境

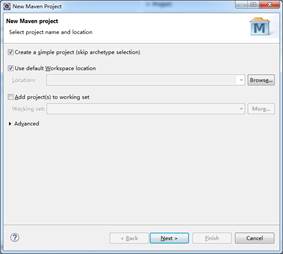

打开Eclipse选择FileàNewàMaven Project创建Maven工程,选择“Create a simple project ”选项,点击【Next】按钮,会进入“New Maven Project”界面,如图1所示。

图1 创建Maven工程

在图1中,勾选“Create a simple project(skip archetype selection)”表示创建一个简单的项目(跳过对原型模板的选择),然后勾选“User default Workspace location”表示使用本地默认的工作空间之后,点击【Next】按钮,如图2所示。

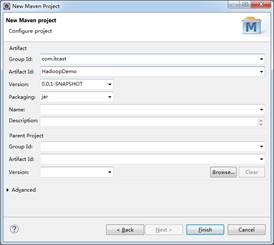

图2 创建Maven工程配置

在图2中,GroupID也就是项目组织唯一的标识符,实际对应Java的包结构,这里输入com.itcast。ArtifactID就是项目的唯一标识符,实际对应项目的名称,就是项目根目录的名称,这里输入HadoopDemo,打包方式这里选择Jar包方式即可,后续创建Web工程选择War包。

此时Maven工程已经被创建好了,会发现在Maven项目中,有一个pom.xml的配置文件,这个配置文件就是对项目进行管理的核心配置文件。

使用Java API操作HDFS需要用到hadoop-common、hadoop-hdfs、hadoop-client三种依赖,同时为了进行单元测试,还要引入junit的测试包,具体代码如文件所示。

文件 pom.xml

1 <?xml version="1.0" encoding="UTF-8"?>

2 <project xmlns=`http://maven.apache.org/POM/4.0.0`

3 xmlns:xsi=`"http://www.w3.org/2001/XMLSchema-instance"`

4 xsi:schemaLocation=`"http://maven.apache.org/POM/4.0.0`

5 ` http://maven.apache.org/xsd/maven-4.0.0.xsd"`>

6 <modelVersion>4.0.0</modelVersion>

7 <groupId>com.itcast</groupId>

8 <artifactId>HadoopDemo</artifactId>

9 <version>0.0.1-SNAPSHOT</version>

10 **<dependencies>**

11 **<dependency>**

12 **<groupId>org.apache.hadoop</groupId>**

13 **<artifactId>hadoop-common</artifactId>**

14 **<version>2.7.4</version>**

15 **</dependency>**

16 **<dependency>**

17 **<groupId>org.apache.hadoop</groupId>**

18 **<artifactId>hadoop-hdfs</artifactId>**

19 **<version>2.7.4</version>**

20 **</dependency>**

21 **<dependency>**

22 **<groupId>org.apache.hadoop</groupId>**

23 **<artifactId>hadoop-client</artifactId>**

24 **<version>2.7.4</version>**

25 **</dependency>**

26 **<dependency>**

27 **<groupId>junit</groupId>**

28 **<artifactId>junit</artifactId>**

29 **<version>RELEASE</version>**

30 **</dependency>**

31 **</dependencies>**

32 </project>```

当添加依赖完毕后,Hadoop相关Jar包就会自动下载,部分Jar包如图3所示。

> 图3 成功导入Jar包

从图3可以看出,所需要的Hadoop的Jar包所在路径就是setting.xml中配置的本地仓库位置。

**2****.初始化客户端对象**

首先在项目src文件夹下创建com.itcast.hdfsdemo包,并在该包下创建HDFS_CRUD.java文件,编写Java测试类,构建Configuration和FileSystem对象,初始化一个客户端实例进行相应的操作,具体代码如文件3-2所示。

文件 HDFS_CRUD.java

```java

1 package com.itcast.hdfsdemo;

2 import java.io.*;

3 import org.apache.hadoop.conf.Configuration;

4 import org.apache.hadoop.fs.*;

5 import org.junit.*;

6 public class HDFS_CRUD {

7 FileSystem fs = null;

8 @Before

9 public void init() throws Exception {

10 // 构造一个配置参数对象,设置一个参数:我们要访问的hdfs的URI

11 Configuration conf = new Configuration();

12 // 这里指定使用的是HDFS文件系统

13 **conf.set("fs.defaultFS", "hdfs://hadoop01:9000")**;

14 // 通过如下的方式进行客户端身份的设置

15 **System.setProperty("HADOOP_USER_NAME", "root")**;

16 // 通过FileSystem的静态方法获取文件系统客户端对象

17 fs = FileSystem.get(conf);

18 }

19 }在上述代码中,@Before是一个用于在Junit单元测试框架中控制程序最先执行的注解,这里可以保证init()方法在程序中最先执行。

小提示:

FileSystem.get()方法从conf中的设置的参数 fs.defaultFS的配置值,用来设置文件系统类型。如果代码中没有指定为fs.defaultFS,并且工程classpath下也没有给定相应的配置,则conf中的默认值就来自于hadoop-common-2.7.4.jar包中的core-default.xml,默认值为:“file:/// ”,这样获取的不是DistributedFileSystem实例,而是一个本地文件系统的客户端对象。

3.上传文件到HDFS

初始化客户端对象后,接下来实现上传文件到HDFS的功能。由于采用Java测试类来实现JavaApi对HDFS的操作,因此可以在HDFS_CRUD.java文件中添加一个testAddFileToHdfs()方法来演示本地文件上传到HDFS的示例,具体代码如下:

@Test

public void testAddFileToHdfs() throws IOException {

// 要上传的文件所在本地路径

Path src = new Path("D:/test.txt");

// 要上传到hdfs的目标路径

Path dst = new Path("/testFile");

// 上传文件方法

fs.copyFromLocalFile(src, dst);

// 关闭资源

fs.close();

}从上述代码可以看出,可以通过FileSystem对象的copyFromLocalFile()方法,将本地数据上传至HDFS中。copyFromLocalFile()方法接收两个参数,第一个参数是要上传的文件所在的本地路径(需要提前创建),第二个参数是要上传到HDFS的目标路径。

4.从HDFS下载文件到本地

在HDFS_CRUD.java文件中添加一个testDownloadFileToLocal()方法,来实现从HDFS中下载文件到本地系统的功能,具体代码如下:

// 从hdfs中复制文件到本地文件系统

@Test

public void testDownloadFileToLocal() throws IllegalArgumentException,

IOException {

// 下载文件

fs.copyToLocalFile(new Path("/testFile"), new Path("D:/"));

fs.close();

}从上述代码可以看出,可以通过FileSystem对象的copyToLocalFile()方法从HDFS上下载文件到本地。copyToLocalFile()方法接收两个参数,第一个参数是HDFS上的文件路径,第二个参数是下载到本地的目标路径。

注意:

在Windows平台开发HDFS项目时,若不设置Hadoop开发环境,则会报以下的错误:

java.io.IOException: (null) entry in command string: null chmod 0644 D:\testFile解决方式:

(1)根据教材提示,安装配置windows平台hadoop(注意,配置后必须重启电脑),运行没有问题。

(2)直接使用下载的hadoop linux平台下的压缩包进行解压,然后在解压包bin目录下额外添加windows相关依赖文件(winutils.exe、winutils.pdb、hadoop.dll),然后进行hadoop环境变量配置(注意,配置后必须重启电脑),运行同样没有问题。

(3)使用FileSystem自带的方法即使不配置windows平台hadoop也可以正常运行(这种方法下载后就是没有附带一个类似.testFile.crc的校验文件):

fs.copyToLocalFile(false,new Path("/testFile"), new Path("D:/"),true);

5.目录操作

在HDFS_CRUD.java文件中添加一个testMkdirAndDeleteAndRename()方法,实现目录的创建、删除、重命名的功能,具体代码如下:

// 创建,删除,重命名文件

@Test

public void testMkdirAndDeleteAndRename() throws Exception {

// 创建目录

fs.mkdirs(new Path("/a/b/c"));

fs.mkdirs(new Path("/a2/b2/c2"));

// 重命名文件或文件夹

fs.rename(new Path("/a"), new Path("/a3"));

// 删除文件夹,如果是非空文件夹,参数2必须给值true

fs.delete(new Path("/a2"), true);

}从上述代码可以看出,可以通过调用FileSystem的mkdirs()方法创建新的目录;调用delete()方法可以删除文件夹,delete()方法接收两个参数,第一个参数表示要删除的文件夹路径,第二个参数用于设置是否递归删除目录,其值为true或false,true表示递归删除,false表示非递归删除;调用rename()方法可以对文件或文件夹重命名,rename()接收两个参数,第一个参数代表需要修改的目标路径,第二个参数代表新的命名。

6.查看目录中的文件信息

在HDFS_CRUD.java文件中添加一个testListFiles()方法,实现查看目录中所有文件的详细信息的功能,代码如下:

// 查看目录信息,只显示文件

@Test

public void testListFiles() throws FileNotFoundException,

IllegalArgumentException, IOException {

// 获取迭代器对象

RemoteIterator<LocatedFileStatus> listFiles = fs.listFiles(

new Path("/"), true);

while (listFiles.hasNext()) {

LocatedFileStatus fileStatus = listFiles.next();

// 打印当前文件名

System.out.println(fileStatus.getPath().getName());

// 打印当前文件块大小

System.out.println(fileStatus.getBlockSize());

// 打印当前文件权限

System.out.println(fileStatus.getPermission());

// 打印当前文件内容长度

System.out.println(fileStatus.getLen());

// 获取该文件块信息(包含长度,数据块,datanode的信息)

BlockLocation[] blockLocations =

fileStatus.getBlockLocations();

for (BlockLocation bl : blockLocations) {

System.out.println("block-length:" + bl.getLength() +

"--" + "block-offset:" + bl.getOffset());

String[] hosts = bl.getHosts();

for (String host : hosts) {

System.out.println(host);

}

}

System.out.println("-----------分割线-------------");

}

}在上述代码中,可以调用FileSystem的listFiles()方法获取文件列表,其中第一个参数表示需要获取的目录路径,第二个参数表示是否递归查询,这里传入参数为true,表示需要递归查询。